“음식 서빙하는 로봇이 인간을 공격한다면?”...AI석학의 경고 [지식人 지식in]

‘인간과 AI가 어떻게 공존할 것인가’ 저자

“AI 발전 속도 생각했던 것보다 훨씬 빨라

지금 행동하지 않으면 AI 위험 통제 못해”

9월 세계지식포럼서 딥마인드와 대담 예정

상황이 이렇다보니 ‘이러다가 AI가 인간을 지배하는 시대가 오는 것 아니야’ 하는 우려가 커지기 시작했습니다. 과거 ‘터미네이터’ 같은 영화를 거론하면서 그냥 농담삼아 하던 이야기가 최근에는 점점 진지하게 거론되고 있습니다.

인간과 AI의 공존에 관한 연구를 오랫동안 한 인물이 있습니다. 바로 세계적인 AI석학으로 손꼽히는 스튜어트 러셀(Stuart Russell) UC버클리 전기·컴퓨터공학과 교수입니다. 이번 지식인 코너에서는 바로 이 러셀 교수에 대해 이야기할까 합니다. 러셀 교수는 다가오는 9월 세계지식포럼에도 참여해 강연할 예정입니다. 아마도 구글 모기업인 알파벳의 인공지능 연구기업 딥마인드의 CIO(최고기술책임자) 릴라 이브라힘과 ‘인간과 AI가 어떻게 공존할 것인가’ ‘AI 윤리’에 대해서 대담할 것으로 보입니다.

러셀 교수는 2016년 ‘인공지능:현대적 접근방식’이라는 책을 냈습니다. 아직도 AI의 교과서라고 불리는 책입니다. 이 때만 하더라도 러셀 교수는 AI의 위험보다 효용성에 대해 훨씬 더 무게를 실은 것으로 보입니다. 그는 책과 당시의 강연에서 “특정 목표가 아닌 다양한 목표, 즉 범용 AI시대가 다가오고 있다”면서 “범용AI는 인간에게 실제로 많은 잠재력을 가져다 줄 수 있다”고 했습니다. 또 “인공지능 알고리즘이 개선되면서 사람들의 지식을 더 빠른 속도로, 또 효과적으로 학습하게 될 것이고 이는 인간에게 지금까지 제공했던 것 이상의 더 많은 혜택을 가져올 것”이라며 “질병, 빈곤 등 인류가 겪었던 문제 해결을 위한 용도로 사용 가능할 것”이라고 했습니다. 그리고 “인공지능의 학습 속도는 연구자들이 생각하는 것보다 더 빠를 수도 있다”고 진단했습니다.

이미 8년 전에 LLM 모델을 기반으로 한 범용AI의 탄생을 예견했으며, 학습을 통해 더 빨리 학습하는 지금과 같은 상황을 예상하고 있었던 셈입니다. 이 때에도 AI의 위험성에 대한 우려가 아주 없었던 것은 아니지만, 러셀 교수는 “최적화된 AI 알고리즘이 인간의 혜택과 합치되지 않을 때 문제가 발생할 수 있는 것은 사실”이라면서도 “AI 위험에 대한 논쟁은 실제보다 훨씬 과장돼 있고, 인간이 AI에 대해 두려워하는 것은 일부 마케팅에 이용당하고 있기 때문”이라고 했습니다.

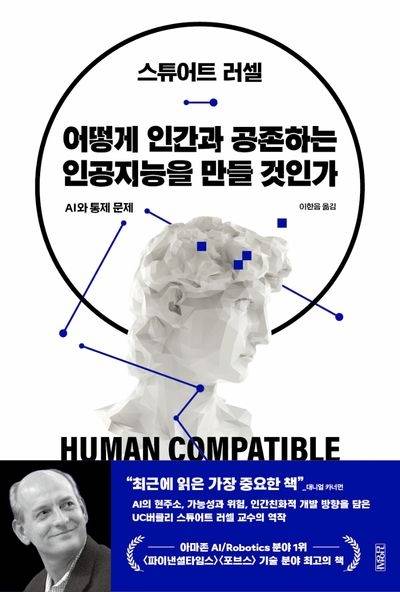

시간이 흘러 5년이 지나고 2021년에 러셀 교수는 새로운 책을 하나 펴냅니다. ‘어떻게 인간과 공존하는 인공지능을 만들 것인가’라는 책입니다. 제목에서도 알 수 있듯이 이제는 AI의 목표와 인간의 혜택이 일치하지 않을 수 있다는 전제를 깔고 있습니다. AI의 위험 내지는 AI윤리에 대한 고민이 시작된 것으로 보이지요.

하지만 이 때까지도 러셀 교수는 AI 위험성을 아주 심각하게 받아들인 것 같지는 않습니다. 미래에 다가올 수 있는 AI 위험에 대해 언급은 했지만 “오늘날 AI는 특정한 과업을 완성하는 데 초점이 맞춰져 있어 인류에게 위협이 되는 상황이 즉각 나오리라 보지 않는다”면서 “아직은 긍정적인 면에서 인간이 더 나은 삶을 영위하는 데 AI가 도움이 될 것이고, 만약에 AI가 인류에게 위협이 되는 상황이 발생한다면 그것은 먼 미래의 일”이라고 했습니다.

3년 후인 올해 초 스튜어트 러셀 교수는 ‘인공지능(AI) 서울 2024’에 온라인으로 참석했는데요, 이 때 러셀 교수는 “범용 인공지능(AGI)이 발전하면 인간의 통제력은 상실될 수 있다”며 “우리는 안전한 AI를 만들어야 한다, 챗GPT 등장으로 AI에 대해 많은 것을 깨달았고, 이제는 우리 모두가 신뢰할 만한 AI를 위해 행동해야 하는 시기”라고 강조했습니다.

러셀 교수는 그러면서 통제 가능한 AI 생태계 구축을 위한 3가지 원칙을 제시했습니다. AI의 최종 통제권은 반드시 인간이 가져야 한다, AI시스템은 사람이 원하는 방식으로 작동할 수 있도록 구성돼야 한다, AI안전에 대한 국제사회의 협력이 필요하다는 것이었습니다.

올해 61세인 스튜어트 러셀 교수는 영국 출신으로 세인트 폴 스쿨 수석 입학생이었습니다. 옥프포드 와덤 칼리지에서 물리학을 전공했으며 미국 스탠포드대학교에서 컴퓨터공학 박사학위를 받았습니다. 현재 UC버클리에서 인간과 공존하는 인공지능을 위한 센터 소장을 맡고 있으며 2021년 엘리자베스 여왕으로부터 대영제국훈장(OBE)를 받았습니다. 옥스포드 위덤 칼리지(Wadham College)의 명예 펠로우, 앤드리 카네기 펠로우 (Andrew Carnegie Fellow), 전미 인공지능 학회(American Association for Artificial Intelligence), 컴퓨팅 기계 협회(Association for Computing Machinery), 미국 과학 진흥 협회(American Association for the Advancement of Science)의 펠로우입니다.

Copyright © 매일경제 & mk.co.kr. 무단 전재, 재배포 및 AI학습 이용 금지

- 신봉선, 11kg 감량 후 남친 깜짝 공개…“우리 이거 한번 찍으면 안돼?” - 매일경제

- “싸이 형 제발 잠 좀 자자”…흠뻑쇼 조명 리허설 새벽 3시 넘어서도 계속 - 매일경제

- “내가 버젓이 살아있는데 어딜”...재산증여 주저한다면 ‘이것’ 해보세요 - 매일경제

- “지방 근무요? 2년 버텼더니 할만해요”...이런 청년 늘리려 지원금 3배 올린다 - 매일경제

- “여름 휴가도 안쓰길래 기특해했는데”...알고보니 연차수당 받고 튀려는 꼼수였다 - 매일경제

- 얼굴맞은 전현희, 허리다친 안상훈 … 다시 '동물국회' - 매일경제

- [속보] 베트남 ‘권력서열 1위’ 응우옌 푸 쫑 공산당 서기장 별세 - 매일경제

- “04년생인데 흡연·음주”…日체조요정, 올림픽대표팀서 퇴출 - 매일경제

- “초라한 모습 보기 싫어서”…‘3번 이혼’ 배우 이상아가 했다는 이것 - 매일경제

- 안정환, 20년 전 축협 암투 충격 폭로 “외인 감독 자르고, 자리 노리는 사람 많았어” - MK스포츠