눈짓만으로 로봇 팔 움직인다…AI 스마트 콘택트렌즈 개발[과학을읽다]

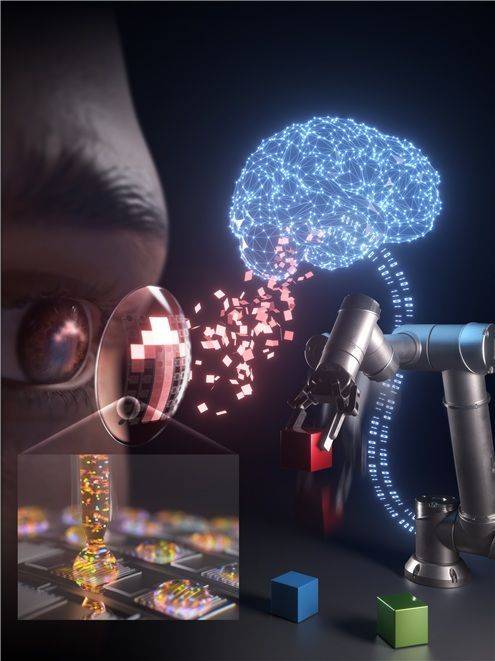

눈동자만 굴려도 로봇 팔이 움직이는 초경량 인간-기계 인터페이스가 구현됐다. 무겁고 복잡한 헤드셋형 확장현실(XR) 장비를 대체할 수 있는 '스마트 콘택트렌즈' 형태로, 시선 정보가 곧바로 로봇 제어 신호로 바뀐다는 점에서 차세대 웨어러블 플랫폼으로 주목된다.

정임두 울산과학기술원(UNIST) 기계공학과 교수(인공지능대학원 겸직) 연구팀은 렌즈 표면에 광학 센서를 직접 인쇄하는 공정 기술과 인공지능(AI) 기반 초해상도 신호 복원 기술을 결합해 눈짓만으로 로봇 팔을 원격 제어할 수 있는 스마트 콘택트렌즈를 개발했다고 15일 밝혔다. 연구 결과는 재료과학 분야 국제학술지 Advanced Functional Materials 최신호 전면 표지 논문으로 선정됐다.

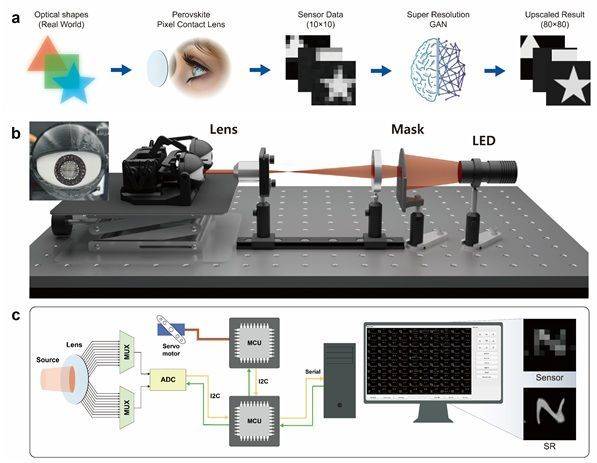

이번 기술의 핵심은 콘택트렌즈 위에 집적된 10×10 배열의 광검출 센서다. 총 100개의 센서가 눈의 움직임에 따라 달라지는 빛 분포를 실시간으로 읽어 시선 방향을 추적한다. 위·아래·좌·우는 물론 대각선까지 정밀하게 구분할 수 있으며, 깜박임 동작을 별도 명령 신호로 활용해 로봇 팔로 물체를 집는 동작까지 구현했다.

곡면 렌즈 한계, AI로 동시에 돌파

이번 성과의 핵심은 스마트렌즈 상용화의 최대 난제로 꼽히던 곡면 센서 집적과 초소형 공간의 낮은 해상도 문제를 동시에 해결했다는 점이다.

연구팀은 이를 위해 '메니스커스 픽셀 프린팅(MPP)' 공정을 새롭게 고안했다. 노즐 끝 액체의 표면장력을 이용해 곡면 렌즈 위 원하는 위치에 센서 잉크를 직접 찍어내는 방식이다. 별도 마스크 없이도 다양한 안구 곡률에 맞춘 맞춤형 센서 인쇄가 가능해 개인별 렌즈 제작에 유리하다. 기존 평면 반도체 공정이 곡면에서 겪는 왜곡 문제를 피하면서도 수 초 내 정밀 패터닝을 마칠 수 있다는 점이 강점이다.

여기에 AI 기반 초해상도 복원 기술을 결합해 렌즈 면적 한계도 극복했다. 실제 센서는 100개에 불과하지만, 초해상도 생성적 적대 신경망(SRGAN)을 적용하면 최대 80×80, 즉 6400개 센서를 쓴 것과 유사한 수준의 고해상도 정보를 복원할 수 있다. 추론 시간은 약 0.03초에 불과해 사실상 실시간 제어가 가능하다.

특히 센서 수를 5×5까지 줄인 극한 조건에서도 AI 복원을 통해 9가지 안구 동작 인식 정확도를 88.4%에서 99.3%까지 끌어올렸다. 안구 모형 실험에서는 시선만으로 로봇 팔이 물체를 집어 옮기는 복합 작업도 안정적으로 수행했다.

정임두 교수는 "별도의 컨트롤러 없이 인간의 시각 정보를 로봇 제어 신호로 직접 변환하는 고도화된 인간-로봇 상호작용 시스템 구현 가능성을 입증했다"며 "산업용 원격 로봇, 재난 탐사 로봇, 국방 무인체계, 의료·재활 보조기기, 스마트 모빌리티 인터페이스 등으로 빠르게 확장될 수 있다"고 말했다.

이번 성과는 XR 기기의 무게 문제를 해결하는 차원을 넘어, 손을 쓰기 어려운 환경이나 신체 거동이 제한된 사용자를 위한 '눈 기반 인터페이스'의 실용화를 앞당겼다는 점에서 의미가 크다. 재난 현장 원격 조종, 수술 보조 로봇, 드론 제어 등 고정밀 시각 입력이 필요한 분야에서 새로운 표준 인터페이스로 자리 잡을 가능성이 크다.

김종화 기자 justin@asiae.co.kr

Copyright © 아시아경제. 무단전재 및 재배포 금지.

- "아파트 계단에서 운동했는데요" 20대女, 알고보니…5개 층에 방화

- "3년 전엔 100만 원이었는데 지금은 0원…공짜로 가져가세요" 농민들 통곡하는 이유

- "당장 짐 싸세요"…곧 통째로 사라질라, 36만명 사는 '위기의 도시'

- 문 붙잡고 버틴 5살 친구들 덕에…소녀 납치 위기 모면

- "아무도 성공 못했는데 한국은 해냈다"…'전설의 심해어' 50만마리 세계 최초 부화

- "183평에 수영장·카바나·정원 2개까지"…3개층 쓰는 '슈퍼 펜트', 자산가 유혹하네[부동산AtoZ]

- "본업보다 더 잘하네" 이불 팔아 반도체 투자 '500억 잭팟'…영업이익 절반 턴 회사의 반전

- "회사 믿고 샀더니 400% 터졌다" 차익만 130억원…159억 된 임원 계좌

- "급식실서 밥도 못 먹겠다"…美 학생들 괴롭히는 신종 사이버 괴롭힘

- "공항 도착하면 2만원 즉시 지급, 바가지섬 오명 벗는다"…제주, 여행객 지원금 혜택