쌓아 올린 HBM, AI 시대의 심장이 되다

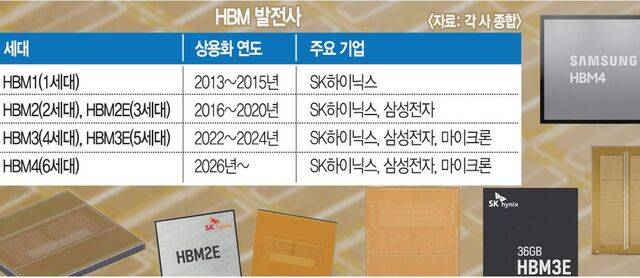

고대역폭메모리 HBM이 인공지능(AI)의 확산과 맞물리면서 메모리 반도체 시장의 패권을 가르는 핵심 기술 자산으로 부상했다. 뉴스와 증권리포트, 투자 유튜브 등 각종 매체에서 HBM이 빠지지 않고 등장하는 것도 이러한 위상을 반영한다. 최근 삼성전자와 SK하이닉스는 엔비디아의 차세대 AI 가속기 ‘베라 루빈’에 탑재될 6세대 HBM인 HBM4 경쟁에 돌입한 상태다. HBM은 이제 단순한 메모리 제품을 넘어 AI 인프라의 핵심축으로 자리 잡고 있다.

하지만 불과 몇 년 전만 해도 HBM은 메모리 시장에서 ‘찬밥’ 신세였다. HBM을 개발하는 부서는 수익성이 불확실한 분야에 과도하게 투자한다는 평가를 받았다. 당시 고성능 메모리 수요의 중심은 게임이나 그래픽 작업이었고, 이 시장에서는 주로 그래픽 D램(GDDR)이 사용됐다. GDDR만으로도 충분한 성능과 용량을 구현할 수 있었기 때문에 상대적으로 제조 공정이 복잡하고 가격이 높은 HBM은 시장의 주목을 받지 못했다.

상황이 급변한 것은 AI 시대가 성큼 다가오면서부터다. 2010년대 들어 인공지능이 스스로 패턴을 학습하는 딥러닝이 빠르게 성장했다. 방대한 데이터를 처리하는 능력이 핵심 경쟁력으로 떠오르자, 2014년 젠슨 황 엔비디아 최고경영자(CEO)는 주로 게임용으로 쓰이던 그래픽처리장치(GPU)를 AI 연산의 핵심 장비로 활용하겠다는 비전을 제시했다.

문제는 메모리 대역폭이었다. 2020년대 초반 AI 데이터센터가 점차 늘어나기 시작했고 2023년 생성형 AI가 확산하면서 GPU 한 대가 처리해야 할 데이터 규모는 과거와 비교할 수 없을 만큼 커졌다. 이때부터 데이터를 얼마나 빠르게 주고받을 수 있는지를 좌우하는 대역폭이 핵심 변수로 떠올랐다. GPU의 연산 성능은 빠르게 높아졌지만, 데이터를 공급하던 기존 GDDR 구조는 필요한 속도를 따라가지 못하며 데이터 병목 현상이 발생했다.

이를 해결할 대안으로 주목받은 게 HBM이다. HBM은 동작 속도를 무리하게 높이는 대신 데이터 통로를 대폭 넓혀 전체 전송량을 극대화하는 구조다. 엔비디아가 2016년 GPU 가속기 ‘테슬라 P100’에 HBM2를 최초로 탑재하면서 HBM 시대가 본격적으로 막이 올랐다. 이후 GPU 한 개에 여러 개의 HBM이 장착되는 구조가 기본 설계로 자리 잡으면서 HBM은 틈새 기술에서 AI 인프라의 핵심 메모리로 재평가되기 시작했다.

일찌감치 HBM 개발에 뛰어든 국내 기업들도 결실을 보기 시작했다. HBM의 강자 SK하이닉스는 2010년대 초반 미국 AI 반도체 기업 AMD와 실리콘 관통 전극(TSV) 기반의 HBM 제품 개발을 위한 협력을 공식화했다. 당시만 해도 시장의 관심이 크지 않았고 HBM 프로젝트는 SK하이닉스 내부에서부터 거센 저항에 부딪혔다. 반복되는 수율 실패와 고객사 반려로 내부 회의론도 컸다. 직원들 사이에서는 HBM 개발팀이 ‘아오지 탄광’이라는 별명으로도 불렸다고 한다.

하지만 SK하이닉스는 포기하지 않았다. 각고의 노력 끝에 2013년 세계 최초로 HBM 개발에 성공했다. 이 프로토타입은 당시 최고 사양의 GDDR5보다 4배 이상 빠르면서도 전력 소비는 40% 이상 낮추는 혁신적인 성능을 입증했다.

삼성전자도 HBM1 기술 개발에 참여했지만 모바일·범용 D램 중심의 수익 구조에 더 무게를 두는 전략을 유지했다. 2016년 엔비디아의 AI 가속기 ‘DGX-1’이 공개되면서 HBM2 수요가 본격화됐고 양사 모두 공급에 나섰다. 삼성전자는 2017년 업계 최초로 8단 적층 HBM2를 상용화하며 당시 가장 빠른 메모리인 GDDR5 대비 8배 빠른 속도를 제공했다.

이후 AI 시장이 급격히 확대되면서 HBM은 전체 실적을 좌우하는 핵심 사업으로 자리매김했다. 이 전환기에서 SK하이닉스와 삼성전자의 전략적 집중도 차이가 본격적으로 드러났다는 평가도 나온다. 2024년 SK하이닉스는 HBM3E를 엔비디아 등 주요 고객사에 공급하며 수율 안정성과 양산 능력을 입증했지만, 삼성전자는 12단 제품의 품질 테스트에서 난항을 겪었다. 결국 엔비디아 물량이 SK하이닉스로 쏠리며 판세가 기울었고 삼성전자는 위기론에 봉착했다.

다음 세대인 HBM4 시장에서는 절치부심한 삼성전자가 반격에 나섰다. 삼성전자는 지난달 세계 최초로 HBM4를 양상 출하하면서 AI 반도체 시장 주도권 탈환에 나섰다. 삼성전자는 나아가 HBM4보다 속도와 전력 효율을 한층 끌어올린 7세대 HBM4E를 올해 하반기 샘플 출하하겠다는 계획도 공개했다. SK하이닉스는 조만간 엔비디아에 HBM4를 공급할 예정으로 알려졌다.

HBM4를 둘러싼 경쟁이 한층 치열해지면서 삼성전자는 차별화 전략으로 ‘커스텀 HBM’ 역량도 강조하고 있다. 송재혁 삼성전자 디바이스솔루션(DS) 부문 최고기술책임자(CTO) 지난달 11일 열린 ‘세미콘코리아 2026’에서 “HBM 자체를 Z축으로 올리는 방식인 ‘zHBM’ 기술을 개발할 계획”이라며 “HBM4보다 대역폭과 전력 효율을 4배 높일 수 있는 것으로 나타났다”고 언급했다.

HBM 경쟁은 HBM4와 HBM4E를 넘어 차세대 제품인 HBM5로도 이어지는 양상이다. HBM5는 AI 인프라 주도권의 향방을 다시 한번 가를 분기점이 될 것으로 전망된다. 업계는 더 높은 적층 단수와 전송 속도, 전력 효율 개선 등을 통해 전 세대를 넘어서는 성능과 안정적인 수율 확보가 핵심이 될 것으로 보고 있다.

이종환 상명대 시스템반도체학과 교수는 4일 “성능, 수율, 가격 측면에서 문제가 없다면 HBM5에 대한 수요는 당연히 있을 수밖에 없다”며 “마이크론과 중국 기업들이 바짝 쫓아오긴 하겠지만 당분간은 국내 반도체 투톱인 삼성전자와 SK하이닉스가 HBM5 시장을 주도할 것”이라고 전망했다.

차민주 기자 lali@kmib.co.kr

GoodNews paper ⓒ 국민일보(www.kmib.co.kr), 무단전재 및 수집, 재배포 및 AI학습 이용 금지

Copyright © 국민일보. 무단전재 및 재배포 금지.

- “염두에 둔 인물 다 죽었다”…트럼프 맘대로 안 되는 ‘포스트 하메네이’

- “발달장애 딸 돌볼 기회를” 박지원, 강선우 선처 호소

- “나의 선태야”…김선태 개인 유튜브에 충주시가 단 댓글

- ‘요격미사일 품귀’… 중동 확전에 주목받는 K방산

- 우울증 환자끼리 SNS서 ‘위태로운 만남’… “긍정 영향 있지만, 엉뚱한 부작용 위험도”

- ‘여수 4개월 영아 살해’ 부모 신상 ‘탈탈’…아기 죽던 날 아빠는 ‘이곳’에

- ‘1억원 공천헌금’ 강선우·김경 구속…“증거인멸 우려”

- 서울 집합건물 새 주인 절반 이상 3040세대

- 李대통령 분당 아파트 매수희망자 등장…“계약은 아직”

- 작전·정보 참모 꿰찬 AI… 팔란티어·클로드, 전쟁 방식 바꿨다