[단독] “엔비디아에 맞설 준비 끝” MS AI칩 ‘마이아 200’ 최종 품질 검수장 가보니

빅테크, 자체 칩 개발해 ‘칩 다양성‘ 전략

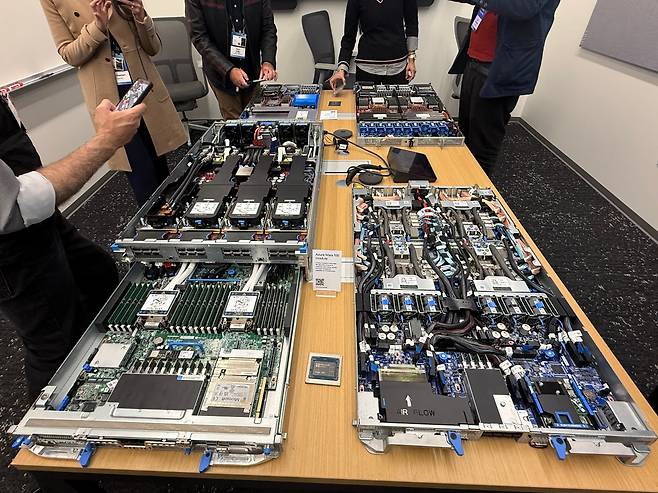

지난달 초 미 워싱턴주 레드먼드 마이크로소프트(MS) 캠퍼스 중심부에 위치한 ‘빌딩 50’. 귀마개를 껴도 소용없을 정도로 서버 소리가 시끄러운 방 안에 들어서자 마치 데이터센터 현장을 통째로 옮겨놓은 듯 서버 랙(장비를 장착하는 금속 수납장)과 냉각 장치가 줄지어 늘어서 있었다. 하나의 랙 안에는 MS의 차세대 인공지능(AI) 칩 ‘마이아 200’이 48개씩 탑재돼 있다. 연구진은 AI 칩의 성능을 확인하고, 냉각 시스템이 잘 작동해 적정 온도(약 35도)를 유지하는지 등을 확인한다. 실제 데이터센터에 배치되기 전 최종 점검을 받는 셈이다.

MS가 전 세계 미디어에 ‘마이아 200’의 개발·검증 과정을 처음 공개했다. 한국 언론 중 본지가 유일하다. 올해 초 MS가 공개한 이 칩은 업계 최고 수준의 추론 효율을 자랑하는 MS의 자체 개발 AI 칩으로, SK하이닉스의 5세대 고대역폭 메모리(HBM3E)가 탑재된다. 제시카 호크 애저 마케팅 담당 부사장은 “AI 시대에는 AI 모델만큼이나 그 밑바탕이 되는 시스템이 중요하다”며 “데이터센터에 최신 칩뿐 아니라 전력·물 소비를 줄이기 위한 새로운 기술도 대거 도입 중”이라고 했다.

◇MS 실리콘 랩 가보니

MS는 비싼 엔비디아 AI 칩에 대한 의존도를 줄이고, 자사 AI 서비스를 최적화하기 위해 자체 AI 칩을 개발했다. 호크 부사장은 “고객들이 원하는 AI 업무나 가격, 성능이 모두 다르다”며 “엔비디아·AMD의 AI 칩과 함께 자체 칩을 활용해 고객에게 최적의 가격 대비 성능을 제공하려는 전략”이라고 했다. 가령 고급 AI 연산에는 엔비디아의 AI 칩을, 경량 연산엔 마이아 200을 쓰도록 해 효율을 높이겠다는 것이다.

MS의 실리콘 랩에서는 ‘마이아 200’이 실제 데이터센터에 배치되기 전 모든 과정에 대한 기술 검증이 이뤄진다. 가장 첫 단계로 AI 칩을 설계하고, TSMC 샘플 웨이퍼의 품질을 점검한다. 이후 대만 TSMC에서 제조돼 배송된 ‘마이아 200’을 실제 서버 환경과 같은 기계 안에 넣고 서버에 연결해 보며 품질과 전력 효율을 확인한다.

완벽하게 검증된 칩은 서버에 탑재돼 다시 연구원들에 의해 점검되며, 이후 랙 단위, 랙에 냉각 시스템을 함께 구동하는 데이터센터 시스템 단위에서 검증을 거친다. MS 관계자는 “데이터센터에 배치되는 칩은 클라우드 서비스 고객들의 막대한 트래픽을 감당해야 하고 작은 결함이 큰 문제로 이어질 수 있기 때문에 사소한 요소 하나하나를 모두 꼼꼼하게 점검한다”고 했다.

MS는 이 같은 까다로운 심사 과정을 통과한 마이아 200을 미 아이오와주 디모인의 데이터센터에 최초로 실전 배치했다. MS는 애틀랜타 등 다른 지역 데이터센터로 배치를 확대할 계획이다.

◇칩 다양성 전략, 한국 반도체에 호재

MS뿐 아니라 여러 AI 기업들은 자체 AI 칩을 개발하고, 용도별로 최적화된 칩을 섞어 효율을 높이는 ‘칩 다양성’ 전략을 취하고 있다. 엔비디아의 그래픽처리장치(GPU)가 비싸고, 구하기도 힘들 뿐만 아니라, 고성능 범용 AI 칩이라 특정 작업에 활용하기엔 비효율적이기 때문이다.

구글은 텐서처리장치(TPU), 아마존웹서비스(AWS)는 트레이니엄 시리즈, 메타는 MTIA를 개발하고 있고, 오픈AI도 브로드컴과 자체 칩 개발 계획을 내놨다. 테슬라도 AI 칩 개발을 이어가고 있다. 엔비디아 역시 GPU를 활용하면서도 추론 효율이 높은 언어처리장치(LPU) 등을 함께 써 에너지 효율을 높이고, 작업을 최적화하고 있다.

AI 기업들의 칩 다양화 전략은 한국 반도체 업계에도 호재다. 여러 기업이 자체 칩을 개발할수록 삼성전자와 SK하이닉스의 메모리 반도체 수요도 늘어난다. MS의 마이아 200에는 SK하이닉스 HBM3E가 탑재되며, 엔비디아에도 삼성전자와 SK하이닉스가 HBM을 공급한다. 삼성전자 파운드리도 엔비디아의 LPU, 테슬라의 자체 칩 생산을 맡으며 존재감을 넓히고 있다.

Copyright © 조선일보. 무단전재 및 재배포 금지.

- 트럼프, 또 한국 비판… “北서 보호해주는데 돕지 않아”

- 트럼프 “이란, 하루에 없앨 수 있어… 내일 밤일 수도”

- ‘100억 마리 유산균’ 먹으면 뭐하나... 이것 ‘한잔’이면 다 날아가는데

- “You go first!” 양보했는데 왜 째려볼까

- ‘아시아 50 베스트 레스토랑’ 홍콩이 최고, 방콕은 최다...손종원, 안성재 눌렀다?

- 러닝 후 혹사 당한 무릎, 부드럽게 회복하는 3분운동

- 마라톤이 준 뜻밖의 변화… ‘술’ 생각이 사라졌다

- 다카이치의 ‘황금 동맹’ 對 이재명의 ‘자주 노선’… 누가 실리를 챙기는가

- 150조원 쏟고도 자급률 20%대… 중국 반도체 ‘멈춰버린 10년’

- [굿모닝 멤버십] ‘반도체 굴기’ 외치던 중국…5년 지나자 조용