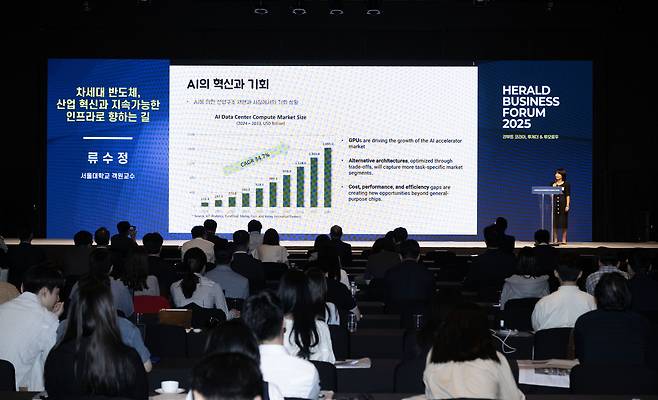

류수정 서울대 교수 “HBM 병목 해결할 새 메모리 형태 필요한 시점” [헤럴드 기업포럼 2025]

전체 맥락을 이해하기 위해서는 본문 보기를 권장합니다.

"7년 전 챗GPT-2와 지금의 챗GPT-5의 모델 규모 차이는 3000배 이상입니다. 인공지능(AI) 산업이 안정적으로 발전하려면 기술에 걸맞는 인프라 구축이 가장 중요합니다."

류수정 서울대학교 객원교수는 24일 AI 산업 인프라 구축을 위해 해결해야 하는 과제로 ▷전력 이슈 ▷메모리 병목 ▷시스템 복원 ▷생태계 구축을 꼽으며 이렇게 말했다.

이 글자크기로 변경됩니다.

(예시) 가장 빠른 뉴스가 있고 다양한 정보, 쌍방향 소통이 숨쉬는 다음뉴스를 만나보세요. 다음뉴스는 국내외 주요이슈와 실시간 속보, 문화생활 및 다양한 분야의 뉴스를 입체적으로 전달하고 있습니다.

전력효율 ·메모리 병목·시스템 복원·생태계 구축 등

AI 산업 인프라 구축 필요성 강조

“기술에 맞는 인프라 같이 개발돼야”

[헤럴드경제=박혜원 기자] “7년 전 챗GPT-2와 지금의 챗GPT-5의 모델 규모 차이는 3000배 이상입니다. 인공지능(AI) 산업이 안정적으로 발전하려면 기술에 걸맞는 인프라 구축이 가장 중요합니다.”

류수정 서울대학교 객원교수는 24일 AI 산업 인프라 구축을 위해 해결해야 하는 과제로 ▷전력 이슈 ▷메모리 병목 ▷시스템 복원 ▷생태계 구축을 꼽으며 이렇게 말했다. 류 교수는 삼성전자 S.LSI 사업부에서 그래픽처리장치(GPU) 개발을 담당하고 과학기술정보통신부 AI·소프트웨어(SW) 자문위원 등을 거쳤다.

AI 기술이 안정적으로 발전하기 위해선 관련 인프라 구축부터 이뤄져야 한다는 게 그의 주장이다. 류 교수는 “최근 생성형 AI 패러독스라는 말이 많이 나오는데, 산업에 끼치는 영향이 크고 혁신도 있지만 자동차와 처음 나왔을 때처럼 교통사고 같은 여러 문제도 있다”며 “기술에 맞는 인프라가 같이 개발돼야 한다”고 설명했다.

류 교수는 구체적인 과제로 AI 사용량과 함께 폭증하는 전력 소비 문제를 가장 먼저 언급했다. 류 교수는 “생성형 AI가 필요로 하는 전력 수요는 폭발적으로 증가하고, 비용 역시 당연히 올라간다”며 “테슬라가 전체 프로세스를 ‘엔드-투-엔드(End-to-End)’ 기술로 모델에 맞는 칩을 개발하는 것처럼, 이런 최적화가 실제로 산업별 솔루션을 견인할 것”이라고 말했다.

방대한 데이터를 처리하면서 발생하는 메모리 병목 현상을 해결하기 위한 기술 개발 필요성도 언급됐다. 류 교수는 “메모리의 병목 현상을 해결하기 위해서 고대역폭메모리(HBM)를 뛰어넘어 새로운 메모리 형태가 필요한 시점”이라며 데이터를 메모리에서 바로 처리하는 ‘프로세싱 인 메모리(PIM)’ 기술을 하나의 사례로 들었다. 이어 류 교수는 “AI의 효율성을 높일 수 있는 주목받는 기술이라고 생각하고 있다. 앞으로 이런 신기술들이 우리나라에서 빨리 자리를 잡아서 발전을 견인해나가야 한다”고 덧붙였다.

다음으로는 AI 시스템 자체의 안정성을 높이기 위한 기술을 강조했다. 류 교수는 “AI 기술을 안정적으로 유지하기 위한 시스템 자체의 안정성도 중요해졌다”며 “큰 모델을 트레이닝할 땐 수천대의 GPU를 엮어 수개월이 소요되는데, GPU 하나가 죽으면 처음부터 다시 해야하고 여기에서 수백만 달러가 날아간다”고 지적했다. 그러면서 “트레이닝 과정에서 특정 시간마다 시스템 상황을 저장하는 타임스태프와, 타임스태프를 활용해 빠르게 시스템을 복원시키는 기술도 발전을 하고 있다”고 부연했다.

기업 등 개발 주체들이 다양하게 참여하는 AI 생태계 구축에 대한 제언도 이어졌다. 류 교수는 “지금은 GPU와 같이 NPU의 생태계가 더 많이 확장돼야 하는 시기다. 오픈소스 스탠다드를 장려하고 다양한 개발이 이뤄져, AI 기술 사용 효율성이 높아지도록 하는 노력이 필요하다”며 “실사용 사례를 만들면 그것을 레퍼런스해서 사용할 수 있는 서비스들이 많아지기 때문에 실사례가 더 많아져야 한다”고 말했다.

Copyright © 헤럴드경제. 무단전재 및 재배포 금지.

- 故전유성 ‘사실혼 전처’ 진미령, 근조화환 애도

- 문원, 신지와 결혼 앞두고 눈물…“대인기피증 겪었다, 아내에게 고마워”

- 이경실, 故전유성 임종 직전 “김신영이 물수건 갈아가며 간호”

- 션, 입양설 해명 “다 정혜영 배 아파 낳아…차인표 선배님과 헷갈리신듯”

- 尹 나체에 오장육부 해부 그림 걸리자, 대구 중구청 전시실 폐쇄

- 빠니보틀, 서울에 단독주택 샀다…“결혼은 아직”

- “BTS 지민 아빠인데요” 걸려온 전화…‘6번째 1억 장학금’ 전북교육청에 쾌척

- [영상] 서울 아파트요? “오늘이 제일 싸죠” 김인만 대표 [헤럴드머니페스타 2025]

- 무당 된 ‘순돌이’ 이건주, 한가인에 “내후년 이혼수 있어” 충격 예언

- “하루 1대도 안 팔려” “그냥 싼 맛에 산다” 조롱받던 샤오미…뜻밖의 ‘반전’