손흥민이 종목 추천을?…AI 날개 단 딥페이크, 사기·음란물부터 여론조작도

[편집자주] 유명인 사칭 온라인 사기 광고가 전세계에서 기승을 부린다. 이에 홀린 일반인들은 물론 범죄에 얼굴을 도용당한 유명인들까지 피해를 호소하지만 사기범들은 가면을 바꿔 쓰고 플랫폼을 갈아타며 암약중이다. 미온적 대응으로 일관하던 빅테크 플랫폼도 '신뢰의 위기'에 직면하자 대응책 마련에 분주하다. 사칭과의 전쟁 최일선에 나선 테크기업과 관계당국의 노력을 점검한다.

유튜브 동영상을 보다 보면 중간 광고에 손흥민이 나온다. 손흥민의 목소리와 표정, 목소리를 흉내내며 투자하라고 꼬드긴다. 광고에 나온 홈페이지에 접속해보면 "축구선수로서 활약하는 동안 투자에도 많은 년동안 참여해왔다" 등 번역기로 돌린 듯한 어설픈 한국어 문구로 버튼 클릭을 유도한다. 물론 이는 가짜다.

AI(인공지능) 기술의 발달로 누구나 손쉽게 딥페이크 동영상과 음성, 사진을 만들어낼 수 있게 되면서 나타난 AI 일상화의 어두운 이면이다. 딥페이크란 딥러닝(Deep Learning)과 페이크(Fake, 가짜)의 합성어다. 조금만 주의를 기울이면 가짜라고 알 수 있는 것들도 있지만 AI 기술의 발달은 감쪽같이 속아넘어갈 정도로 정교한 딥페이크물의 생성을 가능하게 했다. 단순한 오락거리로만 쓰이는 게 아니라 범죄 수단으로 악용된다는 데 문제가 크다.

딥페이크 범죄는 정치의 영역에도 침투했다. 지난 1월 미국에서는 조 바이든(Joe Biden) 미국 대통령의 목소리를 본따 만든 녹음 파일 사건이 불거졌다. 민주당 당원들을 대상으로 투표하지 말 것을 촉구하는 내용의 음성 파일이었다.

튀르키예(터키)에서는 지난해 5월 쿠르드족 무장단체 PKK(쿠르드노동자당)가 야당 후보를 지지하는 딥페이크 동영상이 퍼졌다. 마치 야당 후보가 테러단체의 지지를 받는 것처럼 오인한 유권자들이 야당 후보에게서 등을 돌렸고 에르도안 튀르키예 대통령이 3선에 성공하는 결정적 변수로 작용했다. 국내에서도 지난 2월 '윤 대통령 양심 고백'이라는 제목으로 윤석열 대통령이 '국민을 괴롭혀 죄송하다'는 연설을 하는 것처럼 만들어진 딥페이크 동영상이 유포되기도 했다.

개인을 노린 보이스피싱 등도 딥페이크로 더욱 날개를 단 셈이 됐다. 사진 한두 장만으로 얼굴을 본딴 딥페이크 동영상을 만들 수 있고 몇 초의 음성파일만으로 목소리를 그대로 흉내낼 수 있기 때문에 전화와 영상통화로도 상대방의 진위여부를 확인할 수 없게 된 것이다.

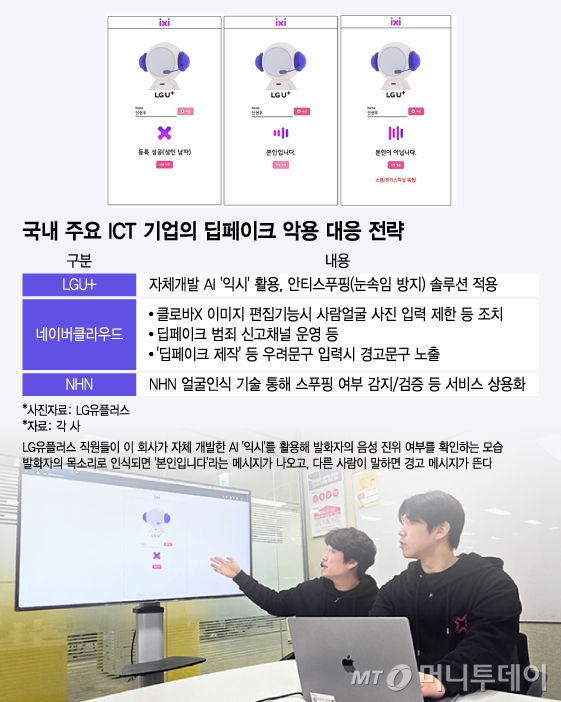

딥페이크물의 악용에 대한 가중처벌 및 안전한 AI 사용을 위한 교육 등이 대안으로 거론되는 가운데 ICT(정보통신기술) 기업도 기술을 활용한 부작용 감소에 노력을 기울이고 있다. 이동통신사 중에서는 LG유플러스가 자체 개발 AI '익시'를 활용해 만든 '화자음성인식' 기술로 보이스피싱 피해 예방에 나섰다. 스푸핑(Spoofing, 눈속임) 방지를 위해 딥페이크 합성기술로 생성된 음원을 탐지하고 딥페이크 음성으로 인증이나 대화를 시도할 때 경고하는 등 솔루션을 개발하고 있다.

자체 초거대 AI 모델을 보유한 네이버는 대화형 AI 서비스 '클로바X'의 이미지 편집기능을 이용할 때 사람 얼굴이 포함된 사진은 업로드 자체가 불가능하도록 강하게 조치하고 있다. 사람 얼굴로 합성해달라는 명령어가 입력돼도 결과물 자체가 나오지 않도록 하고 음란물이나 성착취물을 생성하는 것도 불가능하도록 했다.

NHN 역시 머신러닝 기술로 개발한 '얼굴인식'(Face Recognition) 기술을 상용화했다. 고객이 특정 얼굴 이미지의 스푸핑 여부를 확인하고 싶을 때 얼굴도용 여부를 확인할 수 있도록 하는 서비스다. NHN 얼굴인식 기술은 올초 세계에서 가장 권위 있는 얼굴인식 기술대회 FRVT(Face Recognition Vendor Test)에서 국내 최상위권 성적을 거뒀다.

황국상 기자 gshwang@mt.co.kr

Copyright © 머니투데이 & mt.co.kr, 무단 전재 및 재배포 금지

- 서세원 1주기에…서정희, ♥6살 연하 건축가 남친과 '불후' 출연 - 머니투데이

- "숙제 잘 안고 가겠다"…'사생활 논란' 유영재, 마지막 생방 심경고백 - 머니투데이

- '눈물의 여왕' 김지원, 논현동 '63억' 건물주였다…35억 대출 추정 - 머니투데이

- 최민환과 이혼 후…"우리 아기, 보고싶어" 율희, 아들과 애틋한 대화 - 머니투데이

- '티아라 출신' 아름 "전남친 협박에 강제로 사채…감금 당했다" - 머니투데이

- "죽고싶은 마음, 음악으로 봉사" 유재환, 사기논란 사과…성희롱은 부인 - 머니투데이

- 홈캠에 외도 걸린 남편, 되레 고소…공부 뒷바라지한 아내 '분통' - 머니투데이

- '8만전자'도 깨졌는데…삼성전자, 목표주가는 왜 오를까? - 머니투데이

- "만지는 거 빼고 다 했다" 걸그룹 봉변 뒤…온라인으로 옮겨간 빌런들[뉴스속오늘] - 머니투데이

- 예약 환자만 1900명…"진료 안 해" 분당서울대 교수 4명 떠났다 - 머니투데이