메타, 사람처럼 학습하는 AI 모델 '이미지바인드' 공개

전체 맥락을 이해하기 위해서는 본문 보기를 권장합니다.

메타가 사람처럼 학습하는 다감각 인공지능(AI) 모델을 공개했다.

9일 엔가젯 등 외신에 따르면 메타는 6종의 데이터를 동시에 입력 받아 분석 및 학습할 수 있는 오픈소스 AI모델 이미지바인드를 개발했다고 밝혔다.

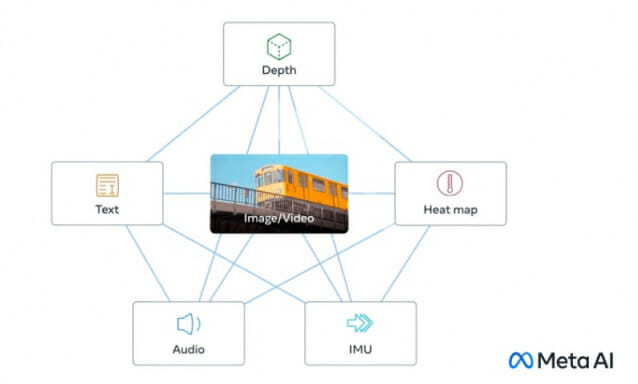

이미지바인드는 사람의 학습방식을 모방해 텍스트, 이미지, 비디오, 오디오 데이터를 비롯해 깊이, 적외선 및 관성 측정(IMU) 등 6종의 데이터를 통합한 데이터쌍 기반으로 학습한다.

이 글자크기로 변경됩니다.

(예시) 가장 빠른 뉴스가 있고 다양한 정보, 쌍방향 소통이 숨쉬는 다음뉴스를 만나보세요. 다음뉴스는 국내외 주요이슈와 실시간 속보, 문화생활 및 다양한 분야의 뉴스를 입체적으로 전달하고 있습니다.

(지디넷코리아=남혁우 기자)메타가 사람처럼 학습하는 다감각 인공지능(AI) 모델을 공개했다.

9일 엔가젯 등 외신에 따르면 메타는 6종의 데이터를 동시에 입력 받아 분석 및 학습할 수 있는 오픈소스 AI모델 이미지바인드를 개발했다고 밝혔다.

사람은 시각, 청각, 촉각 등 여러 감각기관을 통해 얻어지는 정보를 구분하지 않고 하나의 큰 데이터로 기억한다. 예를 들어 번화한 거리를 지날 때 주변에 보이는 많은 사람들과 건물, 자동차 소리, 기온 등을 한번에 받아들이고 이후에 떠올리는 식이다.

이미지바인드는 사람의 학습방식을 모방해 텍스트, 이미지, 비디오, 오디오 데이터를 비롯해 깊이, 적외선 및 관성 측정(IMU) 등 6종의 데이터를 통합한 데이터쌍 기반으로 학습한다.

주변 소리나 사물의 형태, 온도, 움직이는 방식 등 여러 데이터를 통합해 전체적인 상황과 변화를 AI 스스로 분석할 수 있다.

메타 AI연구팀는 이미지바인드가 특정 데이터 형식에 맞춰 훈련된 AI모델보다 더 적은 데이터 학습으로도 높은 성능을 내는 결과를 확인했다고 밝혔다. 6종의 다른 데이터를 통해 전체적인 모습을 비교할 뿐 아니라 상관관계가 높은 데이터들을 중심으로 분류하기 유리하다는 것이다.

예를 들어 검색 대상이 자동차라면 형태와 함께 엔진소리가 다른 객체와 구분 짓는 특징이 될 수 있다. 이를 통해 형태가 일부 가려지거나 모습이 조금 다르더라도 자동차로 특정하는 것이 가능하다는 설명이다.

메타는 미세조정 학습을 요구하지 않는 고성능 컴퓨터 비전 모델 DINOv2와 범용 분할 모델인 SAM 등 오픈소스 AI 도구를 추가하는 등 점차 기능을 향상시킬 계획이다.

또한, 공개한 6가지 감각 외에도 촉각, 후각 등 다양한 감각을 구현하는 것을 목표로 하고 있다고 밝혔다. 이를 활용하면 텍스트, 이미지 등의 데이터를 기반으로 보다 사실적이고 몰입적인 가상환경을 만들 수 있을 전망이다.

메타의 이산 미스라 연구과학자 등 연구진은 “'6가지 감각을 연결하는 연구를 진행하며, 촉각, 후각 및 기능적 자기공명영상(fMRI) 뇌 신호 등 가능한 한 많은 감각을 연결하는 새로운 양식을 도입하면 보다 풍부한 인간 중심 AI 모델 구현이 가능할 것이라고 생각한다"며 "아직 다중 모드 학습에 대해 알아야 할 것이 많이 남아있는 단계로 이미지바인드는 신중하게 이미지를 평가하고 이미지 생성 및 검색에 새로운 응용 프로그램을 보여주는 과정에 해당한다"고 설명했다.

남혁우 기자(firstblood@zdnet.co.kr)

Copyright © 지디넷코리아. 무단전재 및 재배포 금지.

- 포자랩스, AI 작곡 플랫폼 출시 앞서 신규 로고 공개

- 세일즈포스, '세일즈포스 라이브코리아 2023' 23일 개최

- 구글I/O에서 PaLM 2.0 공개되나

- "생성AI 한계점, 기술 융합으로 극복해야"

- 오픈AI·구글 퇴사 직원, 공감하는 AI챗봇 출시

- [유미's 픽] AI가 들러리인가…하정우·임문영 두 축 선거판으로

- 애플 '아이폰17', 1Q 세계 판매 1위...삼성 갤럭시는

- 벤츠 "화려함에 매몰되지 않겠다"...'물리버튼' 부활 예고

- 광고 속 그 연예인, 진짜일까…'AI 무단 합성' 칼 빼든 미국

- 팀 쿡 퇴임 기념?...애플, '무지개 색' 워치 밴드 공개