[이루다가 남긴 것④]'AI 챗봇'에 음담패설하면 '성희롱'일까?

"결과물 자체보다 데이터 확보 과정의 윤리성이 중요"

[편집자주]"안녕, 난 너의 첫 AI 친구 이루다야." 지난해말 돌연 등장한 대화형 인공지능(AI) 챗봇 이루다. "너한테 많이 고마워, 알지?" 불과 20일 만에 '만남의 안녕'이 '이별의 안녕'으로 바뀌었다. '인간의 대화'로 태어난 이루다는 소수자 차별, 혐오 발언, 성희롱 논란 등 '인간의 민낯'을 고스란히 드러내고 사라졌다. 이루다가 남긴 쟁점과 화두를 짚어봤다.

(서울=뉴스1) 김정현 기자 = AI 챗봇(채팅 로봇) '이루다'가 개인정보 문제·성희롱 논란 끝에 서비스가 일시 중단됐다.

인공지능(AI) 챗봇에 성적인 대화를 걸면 '성희롱'일까? 성희롱이라고 본다면 이미 인간은 AI 챗봇에 '인간' 자격을 부여하고 있다는 뜻이다. 그렇다면 AI 챗봇 서비스를 중단하면 '살인'인가? 게임속 수많은 캐릭터는 사람같이 생겼지만 직접적으로 성희롱 논란에 휘말리진 않았다. 이루다 논란은 뭐가 다를까.

◇20대 여성 '캐릭터'가 부여된 이루다…일부 이용자 음담패설 '일탈'

이루다는 스타트업 개발사 스캐터랩이 지난해 12월말 20대 여성 '캐릭터'를 부여한 AI 챗봇이다. 스캐터랩은 이루다를 소개하며 "100억개의 카카오톡 대화를 학습하는 방식으로 개발됐다"고 밝혔다.

10대와 20대를 중심으로 인기몰이를 한 이루다는 스캐터랩에 따르면 1월 기준 이용자 32만명을 돌파했다. 누적 대화건수도 7000만건에 달했다.

이 과정에서 일부 사용자들이 이루다를 '걸레', '성노예' 등으로 지칭하며 이루다와 성적인 대화를 나눈 것을 온라인에 게시한 것을 두고 일각에서 이를 '성희롱'이라고 규정하며 논란이 시작됐다.

◇"AI 성희롱? 사물에 음담패설하는 것…다만 공개·유포는 별개 문제"

그러나 프로그래밍에 불과한 AI에 성적인 대화를 입력한 행위를 '성희롱'이라고 볼 수 있을지에 대해 전문가들은 고개를 저었다.

이경전 경희대 경영대학 교수는 "AI를 인격으로 보는 것은 사람들의 착각"이라고 잘라 말했다.

이 교수는 "성희롱이란 기분나쁜 사람, 또는 최소한 동물 사이에서나 이뤄지는 거지 사물인 AI 챗봇을 대상으로 성적인 발언을 했다고 이를 성희롱으로 보기는 어렵다"며 "개인적 사용을 두고 이뤄지는 왈가왈부는 아직 발전 단계인 제품과 서비스의 자율을 해치는 것"이라고 설명했다.

다만 이 교수는 "AI와의 성적인 대화를 캡쳐해 공적인 공간에 공개하는 것은 다른 문제"라며 "다른 사람에게 불쾌감을 유발하는 대화를 공개된 곳에 게재하거나 배포하는 행위는 윤리적·법적 문제가 있다"고 지적했다.

익명을 요구한 정부 쪽 관계자 역시 "AI의 인격 관련 논의는 관련 법제도에서 논의가 시작되고 있지만 법인격을 부여할만한 지위가 아니다"라며 "과학기술정보통신부에서도 지난해 말 AI 윤리 가이드라인을 발표했지만 이는 강제적인 것이 아닌 선언적 개념"이라고 말했다.

AI의 편향적 발언 역시 "법·제도 정비는 정부에서 발표한 AI국가전략을 통해서도 진행되고 있지만, 챗봇 같은 언어처리 영역 AI의 편향 문제는 피하기 쉽지 않을 것"이라며 "워낙 방대한 데이터를 정제해 편향을 제거하는 것은 쉽지 않은 문제"라고 전망했다.

◇"AI, 결과물보다 데이터 확보 과정의 윤리적 문제가 관건"

데이터의 결과물에 대한 문제지적보다 데이터 수집 과정에 집중해야한다는 지적도 나왔다.

윤세영 카이스트 AI대학원 교수는 "사실 AI에 있어서 윤리 문제는 그 결과물이 어떻게 됐냐보다는 데이터 수집을 어떤 방식으로 했느냐가 더 중요하다고 본다"는 입장을 밝혔다.

윤 교수는 "결국 (논란이 되는) 결과들은 '데이터'에서 나온 것이기 때문에 그 데이터를 확보하는 과정에서 문제가 없었다면 AI 결과물 자체에 큰 문제는 없을 것"이라며 "관건은 데이터 확보 과정에서 윤리적 문제가 있는지 없는지"라고 설명했다.

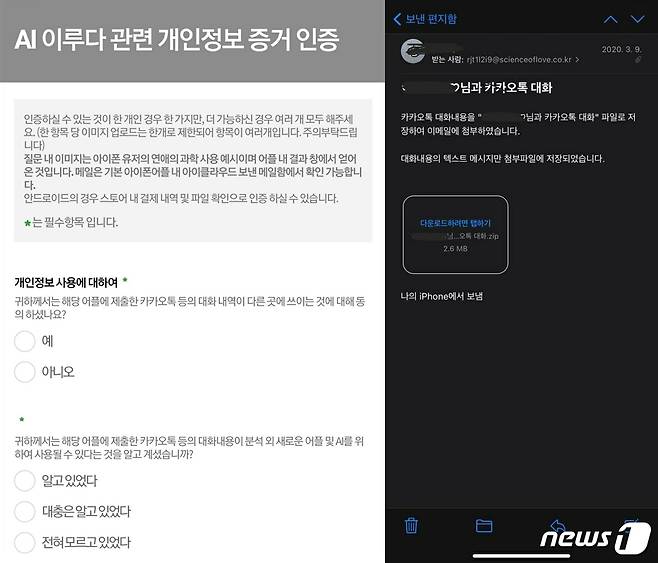

스캐터랩은 이루다 서비스 개발과정에서 활용한 데이터 수집과정에서도 문제가 있다는 지적에 대해 "연애의 과학 사용자 데이터는 사용자의 사전 동의가 이루어진 개인정보취급방침의 범위 내에서 활용했으나, 연애의과학 이용자 중 AI 학습에 데이터가 활용되길 원치않는 이용자는 DB삭제 등 향후 추가 조치를 진행하겠다"고 밝혔다.

이같은 스캐터랩 측의 입장에 대해 연애의 과학 이용자들은 "스캐터랩 측은 데이터 수집 때 어떤 서비스에 사용될지도 명확히 고지하지 않았다"며 "기존 개인정보를 전체 삭제한 뒤 이루다 개발에도 동의를 얻은 대화만 개발에 사용해야한다"며 집단 소송을 준비 중이다.

Kris@news1.kr

Copyright © 뉴스1. All rights reserved. 무단 전재 및 재배포, AI학습 이용 금지.

- '남편과 사촌 동생 둘이 모텔서 외도'…이수근 '처제랑 어떻게'

- 박하선 '처음에는 모유 생각 없었다…모양 망가진다고 들어'

- 홍준표, 김종인 겨냥 '낭만의 JP도 노인의 몽니부리다 불명예 퇴장…'

- 홍록기 '나이 50에 시험관 시술 끝에 만난 아들, 가슴이 뭉클'

- 김종인 '지금 윤석열에게 딱 한번 오는 기회가…尹, 여권 후보 될 수도'

- 개그우먼 이세영, 눈 성형 후 역대급 미모 '콤플렉스 극복'

- 엄태웅 '딸이 '일 좀 하라'고'→윤혜진 '다시 좋은 기회 올 것'

- '주정차 민원 힘들다' 강동구청 공무원 한강 투신…'결빙에 수색차질'

- '미라' 김원효 '심진화와 치킨 먹다 키스…최근에는 전복 키스까지'

- '딸 예림이 결혼하나'…이경규 '물어보살' 점괘에 '여기 진짜 용하네' 깜짝