'이루다'가 쏘아 올린 차별금지..AI 윤리 법제화 말도 안돼

전체 맥락을 이해하기 위해서는 본문 보기를 권장합니다.

인공지능(AI)에 윤리기준을 만들고 법제화해야 할까.

성희롱과 혐오 발언, 개인정보 유출 논란으로 여론의 뭇매를 맞은 AI 챗봇 '이루다'가 지난 11일 서비스를 중단하고 서비스 개선에 나서기로 하면서 AI 윤리기준을 법으로 강제해야 한다는 주장까지 나온다.

이 글자크기로 변경됩니다.

(예시) 가장 빠른 뉴스가 있고 다양한 정보, 쌍방향 소통이 숨쉬는 다음뉴스를 만나보세요. 다음뉴스는 국내외 주요이슈와 실시간 속보, 문화생활 및 다양한 분야의 뉴스를 입체적으로 전달하고 있습니다.

남궁훈 카카오게임즈 대표 "엉뚱한 규제로 혁신 가둘까 걱정"

정부도 윤리규범으로 'AI윤리기준'발표

'알고리즘 설명요구권', 'AI 실수 회복탄력성' 정도는 필요

[이데일리 김현아 기자]]

인공지능(AI)에 윤리기준을 만들고 법제화해야 할까. 성희롱과 혐오 발언, 개인정보 유출 논란으로 여론의 뭇매를 맞은 AI 챗봇 ‘이루다’가 지난 11일 서비스를 중단하고 서비스 개선에 나서기로 하면서 AI 윤리기준을 법으로 강제해야 한다는 주장까지 나온다.

하지만 전문가들은 AI 윤리기준을 법으로 강제하는 것은 불가능하다고 한다. 시대와 장소, 사회·문화적 차이에 따라 달라지는 윤리를 법으로 강제해 처벌하면 또 다른 빅브라더(Big Brother) 세상이 올 수 있고, 이제 어린아이 수준인 대한민국의 AI 산업이 좌초될 수 있다는 얘기다.

전문가들은 어기면 처벌받는 법이 아니라 ‘AI 알고리즘에 대한 설명요구권’, ‘소수 집단 등에 대한 차별 발생시 회복 탄력성’ 같은 게 중요하다는 입장이다.

![[이데일리 문승용 기자]](https://img2.daumcdn.net/thumb/R658x0.q70/?fname=https://t1.daumcdn.net/news/202101/12/Edaily/20210112213356332zhea.jpg)

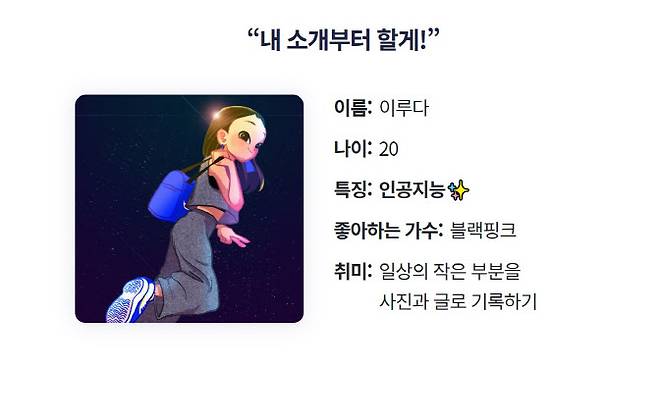

‘이루다’는 스캐터랩이 지난달 23일 출시한 AI 챗봇이다. 20대 여성을 표방하며 애인처럼, 친구처럼 친근하게 대화해 출시 일 주일여 만에 이용자가 40만 명이 넘는 등 주목받았다. 하지만, 일부 악성 네티즌이 성희롱을 도구 삼아 구설에 올랐고, 이루다가 동성애·장애인·여성을 차별하는 발언을 해 논란이 커졌다.

이를 두고 이재웅 전 쏘카 대표는 자신의 SNS에서 이루다 중단을 촉구하면서 “AI 챗봇, 면접·채용, 뉴스 추천 등이 인간에 대한 차별, 혐오를 조장하는 것은 아닌지 포괄적 차별금지법을 만들어 AI를 학습시키는 우리 인간들의 규범과 윤리도 보완했으면 좋겠다”고 주장했다. 특히 “로직이나 데이터에 책임을 미루면 안 된다. 사회적 감사가 필요하다”며, 장혜영 의원(정의당)의원이 발의한 차별금지법에 AI윤리 문제를 포함해야 한다고 언급했다.

![[이데일리 문승용 기자]](https://img1.daumcdn.net/thumb/R658x0.q70/?fname=https://t1.daumcdn.net/news/202101/12/Edaily/20210112213357631kzuk.jpg)

그러나 IT 기업들 대부분은 이 전 대표와는 온도 차가 난다. 법보다는 윤리규범으로서 AI윤리기준이 존재해야 한다는 의미다.

남궁훈 카카오게임즈 대표는 SNS를 통해 “AI 관련 규제론이 고개를 들려 하고 있다. 엉뚱한 규제로 혁신을 또 가둬두지 않을지 걱정스럽다”고 밝혔다. 남궁 대표는 “이루다는 교육을 목적으로 만들어낸 인공지능 슈퍼컴이 아니라 앞으로 수없이 출시될 여러 AI 캐릭터 중의 하나일 뿐”이라고 했다.

지난달 23일 ‘AI 윤리기준’을 자율규범 형태로 발표한 과학기술정보통신부 김경만 인공지능기반정책과장은 “정부가 윤리기준을 법이 아니라 연성규범으로 만든 것은 AI 기술 발전을 방해하지 않고 정당한 AI 기업이 정당한 방법으로 이윤을 추구하도록 하기 위해서”라면서 “같은 이유로 전 세계 국가 중 AI윤리기준을 법제화한 나라는 없다”고 말했다.

과기정통부는 AI 윤리를 법으로 강제하지는 않지만, 일정 규모 이상의 대기업, 생명이나 신체·여론형성과 관련된 AI(고위험 AI)로부터 서비스받는 사람들이 질문하면 AI알고리즘의 원리를 제한적으로 답변받을 수 있는 ‘알고리즘 설명요구권’ 정도는 필요하다는 입장이다. 다만, 이는 모든 기업이나 모든 분야의 AI에 대한 설명요구권은 아니다.

최경진 가천대 법학 교수는 “AI 윤리가 부족하다고 다 막으면 AI는 발전할 수 없다”며 “시대와 장소에 따라 바뀌는 게 윤리여서 절대적인 윤리기준을 제시하지 않는 게 세계적인 추세다. 얼마나 빨리 실수를 찾아 복원하는가 같은 회복탄력성이 중요하다”고 말했다. 그는 “섣부르게 AI윤리 법제화를 주장하는 것은 마치 정치권에서 검색 결과에 포털이 개입하지 말라면서 검색 방향을 제시하는 것과 같다”고 말했다.

김현아 (chaos@edaily.co.kr)

Copyright © 이데일리. 무단전재 및 재배포 금지.

- 최종건 오늘밤 이란서 카타르로…韓선박 억류 장기화될까

- "공군부대 치킨 환불 사장님 많이 놀라..행패? CCTV 확인해보라"

- '얼굴' 드러낸 'LG 롤러블'…“늘었다 줄었다 신기하네”

- 심은진 측 "전승빈과 법적 부부 됐다" [전문]

- 또 '퇴근길 폭설'…빙판길에 차량들 '엉금엉금'

- 배진웅 "강제추행 NO, 증거 있어"vs여후배 "강간미수 혐의 고소" [종합]

- 낮술 운전에 6세 사망, 1심서 징역 8년..유족 "너무하다" 오열

- 혹한 속 ‘내복 차림’ 6살…母 “혼냈더니 삐쳐서 나갔다”

- "노래방에서 혼자 노래 중입니다"…새벽에도 들어온 '버팀목자금'

- 허경환 "닭가슴살 사업 연매출? 350억.. 직원 늘릴 것"